Vyhľadávač

Vyhľadávač je softvér vytvorený na uľahčenie vyhľadávania na internete pre používateľov. Prehľadáva milióny stránok a poskytuje najrelevantnejšie výsledky....

Zistite, čo je Google Spider (Googlebot), ako prehľadáva a indexuje webové stránky a prečo je dôležitý pre SEO. Objavte, ako optimalizovať svoj web pre lepšie prehľadávanie.

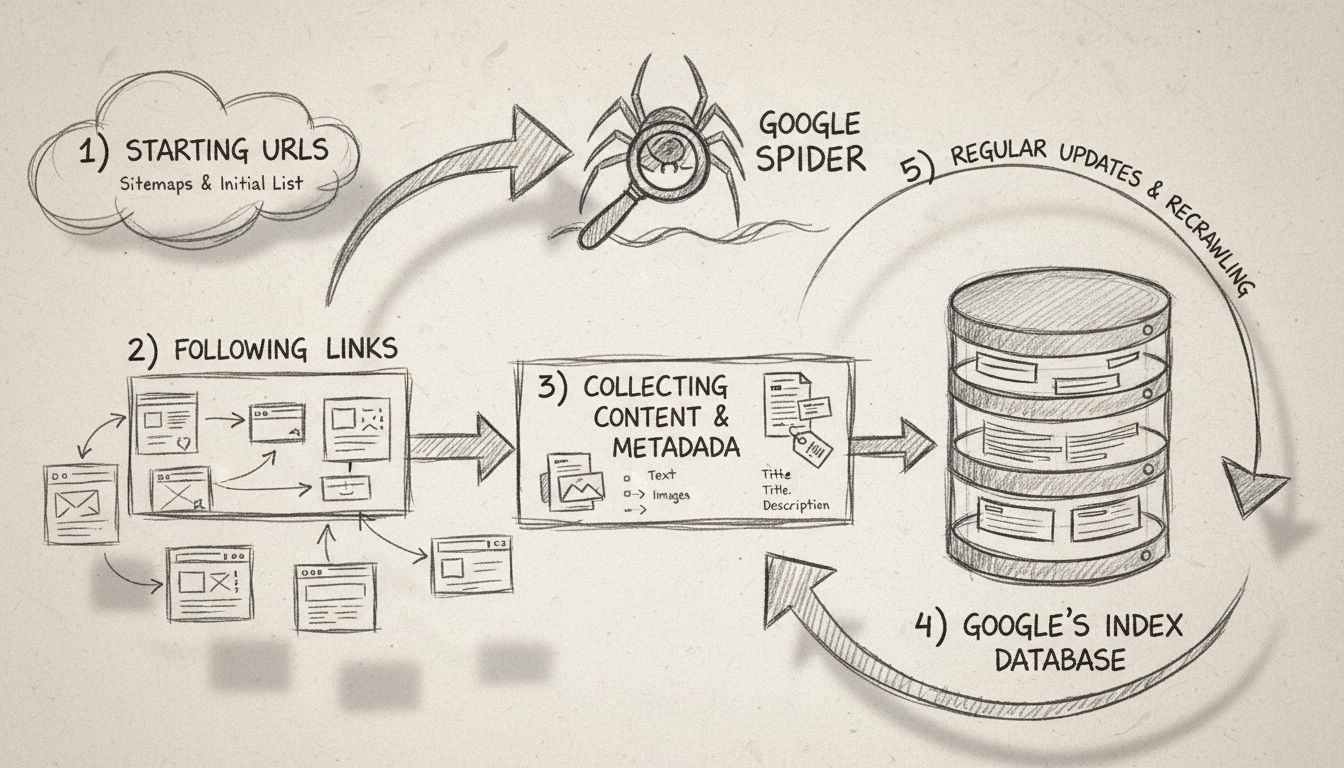

Google Spider, oficiálne známy ako Googlebot, je automatizovaný program, ktorý prehľadáva webové stránky s cieľom objaviť, indexovať a ukladať obsah do databázy Googlu. Sleduje odkazy, aby našiel nové alebo aktualizované stránky, ktoré sú následne spracované a pridané do vyhľadávacieho indexu Googlu, čo umožňuje vyhľadávaču poskytovať relevantné výsledky používateľom.

Google Spider, formálne známy ako Googlebot, je automatizovaný softvérový program, ktorý systematicky prehľadáva internet za účelom objavenia, analýzy a indexovania webového obsahu. Je to hlavný nástroj, ktorý Google používa na prieskum webových stránok, zhromažďovanie informácií a budovanie svojho rozsiahleho vyhľadávacieho indexu. Bez Googlebotu by Google nemohol objavovať nové stránky, zisťovať aktualizácie existujúceho obsahu ani poskytovať relevantné výsledky vyhľadávania miliardám používateľov po celom svete. Spider pracuje nepretržite a denne navštevuje milióny webových stránok, aby zabezpečil, že index Googlu zostáva aktuálny a komplexný.

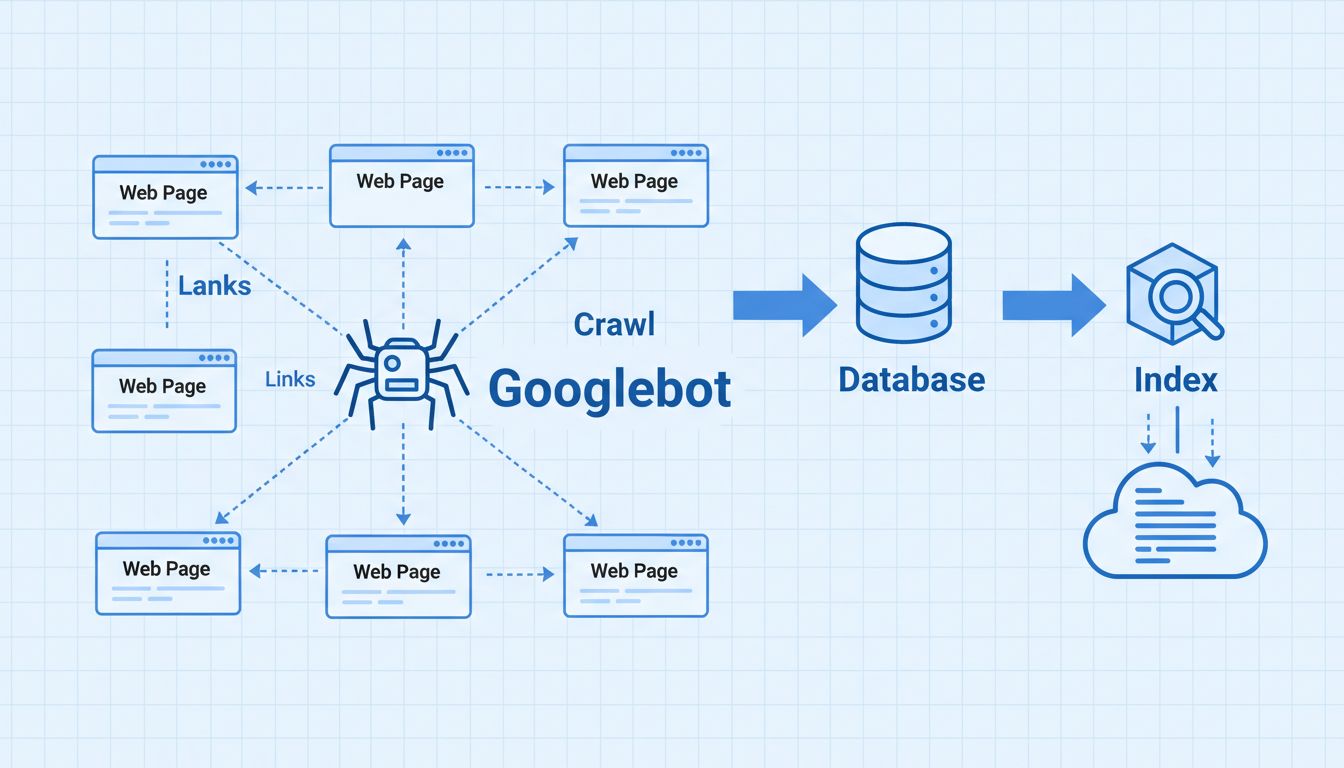

Googlebot je v podstate sofistikovaný webový prehľadávač, ktorý nasleduje komplexný algoritmický proces na určenie, ktoré stránky navštíviť, ako často ich prehľadávať a koľko stránok z každého doménu získať. Prehľadávač číta HTML kód, textový obsah a metadáta na každej navštívenej stránke a následne tieto informácie ukladá do centrálnej databázy Googlu. Tento proces indexovania je základom fungovania vyhľadávačov a priamo ovplyvňuje viditeľnosť vašich stránok vo výsledkoch vyhľadávania.

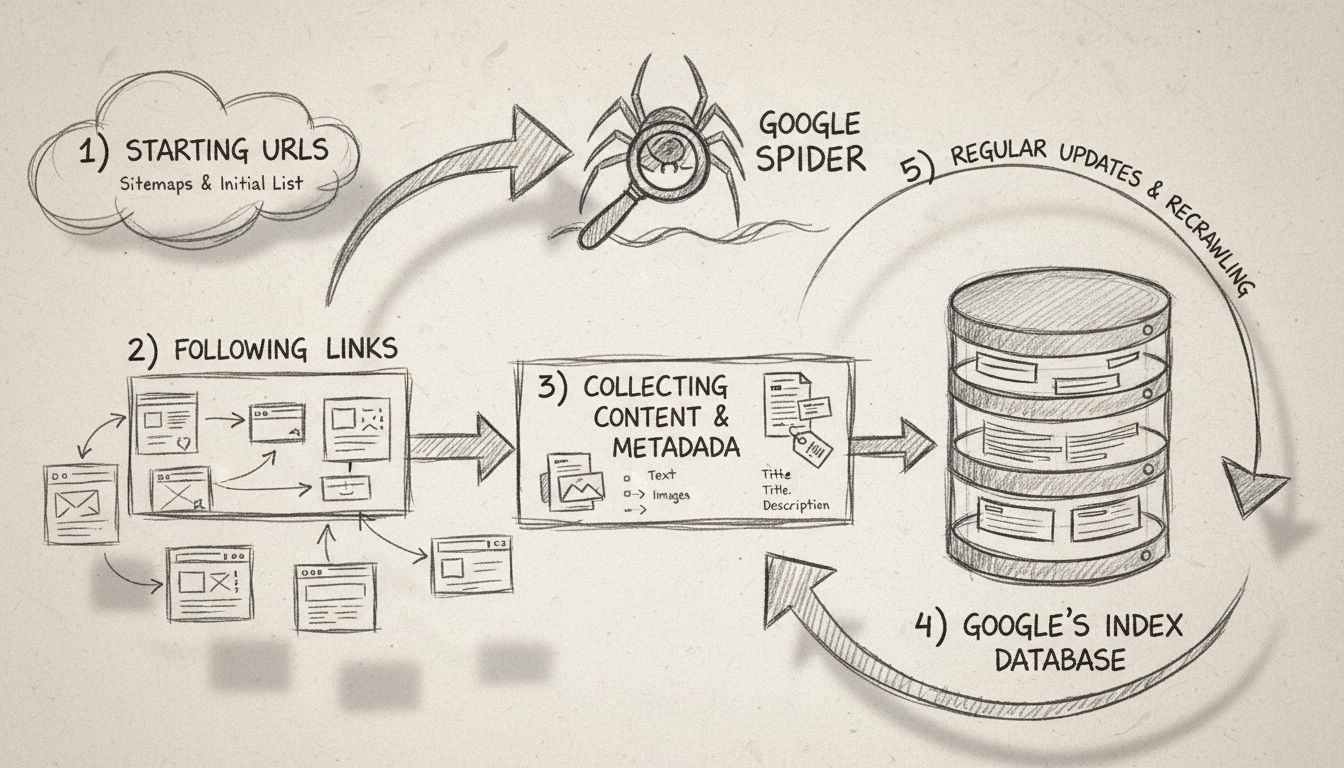

Google Spider pracuje podľa dobre definovaného procesu prehľadávania, ktorý začína so zoznamom známych webových stránok. Tento počiatočný zoznam je vytvorený z predchádzajúcich prehľadávaní a je priebežne dopĺňaný údajmi zo sitemap poskytnutých správcami stránok prostredníctvom Google Search Console. Keď Googlebot navštívi webovú stránku, nielenže číta obsah – vykonáva komplexnú analýzu štruktúry stránky, sleduje interné a externé odkazy a identifikuje akékoľvek zmeny alebo nový obsah, ktorý mohol byť pridaný od poslednej návštevy.

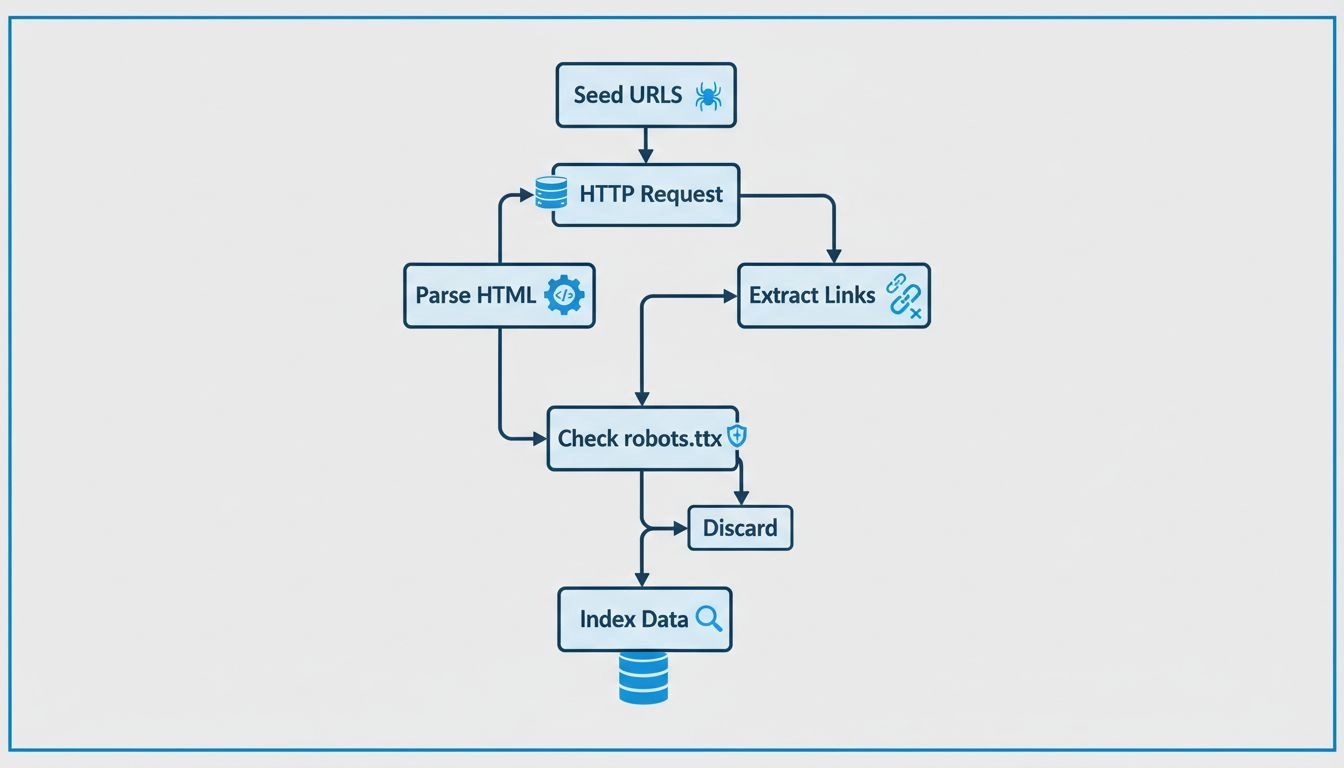

Proces prehľadávania zahŕňa tieto kľúčové kroky: Najskôr Googlebot začína so zoznamom URL adries z predchádzajúcich prehľadávaní a sitemap. Potom sa pohybuje po stránkach sledovaním odkazov (atribúty SRC a HREF) na každej stránke, aby objavil nový obsah. Následne prehľadávač sťahuje a analyzuje obsah každej stránky vrátane textu, HTML štruktúry, metadát a ďalších relevantných informácií. Zhromaždené údaje sú odoslané na servery Googlu na spracovanie a uloženie do vyhľadávacieho indexu. Nakoniec Googlebot v pravidelných intervaloch opakovane navštevuje stránky, aby zistil nové prírastky, aktualizácie alebo zmeny na existujúcich stránkach.

Google prevádzkuje niekoľko špecializovaných variant prehľadávača, pričom každý je určený na špecifické účely a identifikovaný unikátnym user-agent reťazcom. Pochopenie týchto typov pomáha vlastníkom stránok optimalizovať svoje weby pre príslušný prehľadávač. Hlavné varianty Googlebotu zahŕňajú desktopový prehľadávač, mobilný prehľadávač, video prehľadávač, prehľadávač obrázkov a prehľadávač noviniek, pričom každý plní odlišné funkcie v rámci ekosystému indexovania Googlu.

| Typ Googlebotu | User-Agent String | Účel |

|---|---|---|

| Googlebot (Desktop) | Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | Prehľadáva desktopové verzie stránok pre všeobecný vyhľadávací index |

| Googlebot (Mobile) | Mozilla/5.0 (Linux; Android 6.0.1; Nexus 5X Build/MMB29P) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/W.X.Y.Z Mobile Safari/537.36 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | Prehľadáva mobilne optimalizované verzie stránok |

| Googlebot-Video | Googlebot-Video/1.0 | Indexuje video obsah vložený na stránkach |

| Googlebot-Image | Googlebot-Image/1.0 | Prehľadáva a indexuje obrázky pre vyhľadávanie Google Images |

| Googlebot-News | Googlebot-News | Prehľadáva spravodajský obsah pre agregáciu Google News |

Okrem týchto hlavných prehľadávačov Google prevádzkuje aj špecializované boty na iné účely. AdSense Bot kontroluje kvalitu a súlad reklám, zatiaľ čo prehľadávač Mobile Apps Android indexuje obsah z Android aplikácií. Každý bot má odlišný user-agent identifikátor, ktorý umožňuje správcom stránok sledovať, ktorý konkrétny prehľadávač navštevuje ich web prostredníctvom serverových logov. Toto rozlíšenie je dôležité, pretože rôzne prehľadávače môžu mať rozdielne crawl budgety a priority, čo ovplyvňuje, ako často navštevujú vašu stránku.

Google Spider je pre optimalizáciu pre vyhľadávače absolútne kľúčový, pretože rozhoduje o tom, či bude obsah vašich stránok objavený, indexovaný a zaradený do výsledkov vyhľadávania. Ak Googlebot nedokáže efektívne prehľadávať vašu stránku, vaše stránky sa neobjavia v indexe Googlu, čím ostanú neviditeľné pre potenciálnych návštevníkov hľadajúcich vaše produkty alebo služby. Preto je technické SEO – zabezpečenie prístupnosti stránky pre prehľadávače – jedným z najdôležitejších základov úspešnej SEO stratégie.

Keď Googlebot prehľadáva vašu stránku, zostavuje rozsiahly index všetkých slov, ktoré nájde a ich pozícií na stránke, spolu s HTML informáciami ako sú title tagy, meta popisy a štruktúra nadpisov. Tieto indexované informácie sú uložené v databáze Googlu a využívané algoritmami vyhľadávania na hodnotenie stránok a určenie, akú hodnotu má váš obsah pre konkrétne vyhľadávacie dopyty. Čím efektívnejšie dokáže Googlebot prehľadávať váš web, tým častejšie sa vracia a tým rýchlejšie bude nový obsah indexovaný a potenciálne zaradený vo výsledkoch vyhľadávania.

Aby Googlebot mohol efektívne a účinne prehľadávať vašu stránku, je potrebné zaviesť niekoľko technických osvedčených postupov. V prvom rade udržiavajte prehľadnú a logickú štruktúru webu so správnou navigáciou, ktorá uľahčí prehľadávaču objaviť všetky dôležité stránky. Interné prelinkovanie by malo byť strategické a relevantné, s použitím popisných anchor textov, ktoré pomáhajú používateľom aj prehľadávačom pochopiť kontext odkazovaných stránok. Váš web by sa mal načítavať rýchlo, pretože rýchlosť stránky ovplyvňuje efektivitu prehľadávania a to, koľko stránok Googlebot v rámci svojho crawl budgetu zvládne.

Vytvorte a odošlite XML sitemap do Google Search Console, ktorá poskytuje Googlebotovi komplexný zoznam všetkých stránok, ktoré chcete indexovať. Toto je mimoriadne dôležité pri veľkých webových stránkach alebo pri stránkach, ktoré nemusia byť ľahko objaviteľné len prostredníctvom interného prelinkovania. Okrem toho sa uistite, že váš súbor robots.txt je správne nakonfigurovaný na povolenie prístupu Googlebotu k stránkam, ktoré chcete indexovať, a na blokovanie prístupu k citlivým alebo duplicitným častiam obsahu. Dávajte si však pozor, aby ste omylom neblokovali dôležité stránky, pretože by sa vôbec nemuseli indexovať.

Google Search Console je nevyhnutný nástroj na sledovanie toho, ako Googlebot interaguje s vaším webom a identifikáciu problémov s prehľadávaním, ktoré by mohli brániť správnemu indexovaniu. Sekcia Štatistiky prehľadávania poskytuje podrobné informácie o tom, koľko stránok Googlebot prehľadal, koľko času strávil na vašej stránke a koľko chýb zaznamenal. Môžete vidieť priemerný čas odozvy vášho servera, čo priamo ovplyvňuje, ako efektívne dokáže Googlebot prehľadávať vaše stránky – pomalšie servery znamenajú menej prehľadaných stránok za rovnaký čas.

Správa Pokrytie v Google Search Console zobrazuje, ktoré stránky boli úspešne indexované, ktoré majú chyby brániace indexovaniu a ktoré boli z indexu vylúčené. Tieto informácie sú neoceniteľné pri identifikácii technických problémov ako sú nefunkčné odkazy, chyby servera alebo stránky blokované robots.txt, ktoré ste možno nechceli blokovať. Môžete tiež využiť nástroj Kontrola URL na otestovanie, ako Googlebot vidí konkrétnu stránku, vrátane toho, či dokáže zobraziť JavaScript obsah a získať všetky zdroje potrebné na správne zobrazenie stránky.

Každý web má svoj “crawl budget” – počet stránok, ktoré Googlebot na vašom webe prehľadá v danom čase. Pre väčšinu webových stránok crawl budget nepredstavuje obmedzujúci faktor, no pri veľmi veľkých weboch s tisíckami alebo miliónmi stránok je jeho optimalizácia dôležitá. Google prideľuje crawl budget podľa dvoch faktorov: kapacity prehľadávania (koľko zvládne váš server) a dopytu po prehľadávaní (ako dôležitý považuje Google váš web). Zlepšenie rýchlosti stránky a oprava chýb zvyšuje kapacitu prehľadávania, zatiaľ čo tvorba kvalitného, často aktualizovaného obsahu zvyšuje dopyt po prehľadávaní.

Na optimalizáciu crawl budgetu odstráňte duplicitný obsah, ktorý zbytočne plytvá prehľadávacími zdrojmi, opravte nefunkčné odkazy a presmerovacie reťazce a odstráňte stránky, ktoré neposkytujú používateľom hodnotu. Vyhnite sa blokovaniu dôležitých stránok cez robots.txt alebo noindex tagy a zabezpečte, aby bola štruktúra webu taká, že Googlebot nájde všetky dôležité stránky na pár klikov z úvodnej stránky. Pravidelná aktualizácia XML sitemap a odstraňovanie zastaraných stránok pomáha Googlebotovi sústrediť svoje úsilie na obsah, ktorý je pre vaše podnikanie najdôležitejší.

Majitelia webov sa často stretávajú s rôznymi problémami, ktoré bránia Googlebotovi v efektívnom prehľadávaní stránok. Chyby servera (5xx stavové kódy) znamenajú, že váš server má problémy so spracovaním požiadaviek, čo môže zabrániť indexovaniu stránok. Presmerovacie reťazce – keď jedna stránka presmeruje na druhú, ktorá presmeruje na tretiu – zbytočne míňajú crawl budget a spomaľujú indexáciu. Blokované zdroje, napríklad CSS alebo JavaScript súbory blokované robots.txt, môžu zabrániť Googlebotovi správne zobraziť a pochopiť vaše stránky.

Soft 404 chyby nastávajú vtedy, keď stránka vráti stavový kód 200 (úspech), ale obsahuje málo alebo žiadny skutočný obsah, čo mätie Googlebot, či má byť stránka indexovaná. Noindex tagy omylom aplikované na dôležité stránky im bránia v zobrazovaní vo výsledkoch vyhľadávania. Pomalé načítavanie stránok znižuje počet stránok, ktoré Googlebot stihne prehľadať v rámci prideľeného rozpočtu. Na odstránenie týchto problémov pravidelne auditujte svoj web pomocou Google Search Console, sledujte serverové logy pre chyby a využite nástroje ako Screaming Frog na identifikáciu technických problémov skôr, než ovplyvnia vašu viditeľnosť vo vyhľadávaní.

V roku 2025 je Google Spider stále rovnako dôležitý ako kedykoľvek predtým, hoci jeho úloha sa vyvíja s novými technológiami a formátmi obsahu. Googlebot už zvláda aj JavaScript rendering, takže dokáže prehľadávať a indexovať aj obsah generovaný dynamicky pomocou JavaScript frameworkov. Spracúva aj štruktúrované dáta (Schema.org), vďaka čomu lepšie rozumie obsahu stránok a poskytuje rozšírené výsledky vo vyhľadávaní. Indexovanie podľa mobilnej verzie znamená, že Googlebot uprednostňuje prehľadávanie a indexáciu mobilnej verzie vášho webu, čo robí mobilnú optimalizáciu nevyhnutnou pre SEO úspech.

Spider zohráva tiež kľúčovú úlohu v schopnosti Googlu detegovať a bojovať proti spamu, identifikovať hacknutý obsah a zabezpečiť, aby výsledky vyhľadávania zostali relevantné a dôveryhodné. Ako sa vyhľadávače ďalej vyvíjajú s využitím AI a strojového učenia, schopnosti Googlebota v prehľadávaní a indexovaní sú čoraz sofistikovanejšie, vďaka čomu Google lepšie rozumie zámeru používateľov a poskytuje presnejšie výsledky vyhľadávania. Pochopenie fungovania Googlebota a optimalizácia webu podľa toho zostávajú jedným zo základov SEO stratégie.

Rovnako ako Google Spider prehľadáva a indexuje váš obsah, PostAffiliatePro vám pomáha sledovať a optimalizovať výkon affiliate marketingu. Sledujte každý klik, konverziu a províziu s našou špičkovou platformou pre správu affiliate programov.

Vyhľadávač je softvér vytvorený na uľahčenie vyhľadávania na internete pre používateľov. Prehľadáva milióny stránok a poskytuje najrelevantnejšie výsledky....

Zistite, ako fungujú webové prehľadávače – od počiatočných URL adries až po indexovanie. Pochopte technický proces, typy prehľadávačov, pravidlá robots.txt a vp...

Crawlery zhromažďujú dáta a informácie z internetu návštevou webových stránok a čítaním ich obsahu. Zistite o nich viac.

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.